神经网络分类四种模型

- 神经网络

- 2024-04-13 20:44:51

- 8949

神经网络是一种强大的机器学习技术,可用于解决各种任务,包括图像识别、语音识别和自然语言处理。 根据其架构和连接模式,神经网络模型可以分为四种主要类型:

1. 前馈神经网络 (FNN)

结构:单向无环图,层层相连

特征:

信息向前传播,不会返回到以前的层

可用于解决线性可分的问题

示例:感知器、多层感知器 (MLP)

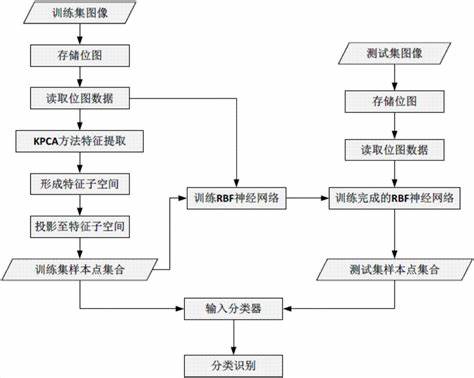

2. 卷积神经网络 (CNN)

结构:具有卷积和池化层的深层架构

特征:

专用于处理具有空间结构的数据(例如图像)

使用卷积和池化操作提取特征

示例:LeNet、VGGNet、ResNet

3. 循环神经网络 (RNN)

结构:循环连接的单元,允许信息在时间步长上流动

特征:

处理顺序或时间依赖数据

可学习长期依赖关系

示例:RNN、LSTM、GRU

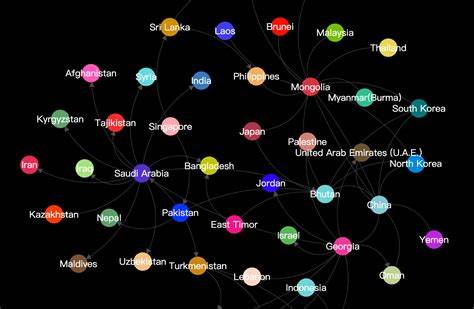

4. 变换器神经网络 (Transformer)

结构:基于自注意力机制,允许神经网络捕捉序列中元素之间的关系

特征:

比 RNN 更加有效,尤其是在处理长序列时

在自然语言处理和机器翻译中广泛使用

示例:BERT、GPT-3、T5

选择模型

选择最佳的神经网络模型取决于手头的任务和数据集。 一般而言:

FNN:适用于线性可分问题,例如数字识别

CNN:适用于处理空间数据,例如图像分类

RNN:适用于处理顺序或时间依赖数据,例如语言建模

Transformer:适用于处理长序列,例如机器翻译

通过了解不同神经网络模型的特性,我们可以根据特定任务和数据集为机器学习问题选择最合适的方法。

上一篇:神经网络简单分类

下一篇:神经网络模型的优缺点